|

网站优化过程中必须了解的robots文件!时间:2022-10-13 1、什么是robots文件? robots文件用于指定spider在网站上的抓取范围,在文件中可以声明网站中不想被搜索引擎抓取或指定被抓取的资源。 2、robots.txt文件怎么写? 文件包含一条或更多的记录,这些记录通过空行分开(以CR,CR/NL, or NL作为结束符),每一条记录的格式如下所示: "<field>:<optional space><value><optionalspace>" 在该文件中可以使用#进行注解,具体使用方法和UNIX中的惯例一样。 该文件中的记录通常以一行或多行User-agent开始,后面加上若干Disallow和Allow行,详细情况如下: robots文件具体详情 User-agent:该项的值用于描述搜索引擎robot的名字。 Disallow:该项的值用于描述不希望被访问的一组URL,这个值可以是一条完整的路径,也可以是路径的非空前缀,以Disallow项的值开头的URL不会被 robot访问。 Allow:该项的值用于描述希望被访问的一组URL,与Disallow项相似,这个值可以是一条完整的路径,也可以是路径的前缀,以Allow项的值开头的URL 是允许robot访问的。 如果"/robots.txt"不存在或者为空文件,则对于所有的搜索引擎robot,该网站都是开放的。 说明:百度会严格遵守robots的相关协议,请注意区分您不想被抓取或收录的目录的大小写,百度会对robots中所写的文件和您不想被抓取和收录的目录做精确匹配,否则robots协议无法生效。 robots.txt文件举例

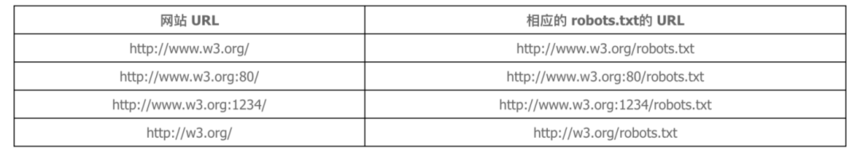

3、robots.txt文件放在哪里? robots.txt文件应该放置在网站根目录下。网站对应robots文件的URL:

免责声明:转载内容来自于百度搜索资源平台,仅用于学习使用,如有异议请及时联系,本人将予以删除。 |